计算机所师生参加ACL 2019

2019年7月28日至8月2日,第57届计算语言学协会年会(The 57th Annual Meeting Association for Computational Linguistics, 简称ACL 2019) 在意大利佛罗伦萨召开。计算机所赵东岩老师、万小军老师、冯岩松老师、严睿老师,以及陶重阳等研究生前往参会。

ACL 是自然语言处理与计算语言学领域的顶级学术会议,每年召开一次。本次会议吸引了三千余人参加,受到了学界和业界的广泛关注。会议包含 Workshop、Tutorial、口头报告、海报展示等多个环节,内容涉及机器翻译,自动摘要,对话系统,信息抽取,文本生成,自动问答等多个领域。

本次会议共收到近3000余份提交论文,最终 660 篇论文被接收,包括 447篇长文和 213 篇短文。计算机所师生在本次会议上共发表了7篇论文,分别做了口头报告和海报展示。论文信息如下:

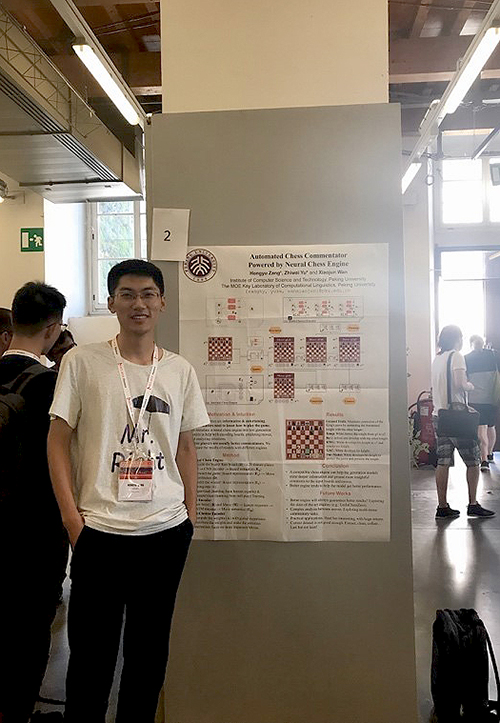

[1] Hongyu Zang, Zhiwei Yu and Xiaojun Wan. Automated Chess Commentator Powered by Neural Chess Engine.

本文提出了一种国际象棋引擎以辅助国际象棋评论生成方法,可以生成五种不同类型的国际象棋评论:Description, Quality, Comparison, Planning 以及 Contexts。本文训练得到的国际象棋引擎具有预测出接下来对局情况的能力,可以给生成模型提供更多的信息,比如给定当前棋局可以预测出下一步最优操作,将预测操作与真实操作进行对比能够辅助生成对比型评论等。通过联合训练国际象棋引擎以及不同类型的生成模型,所提出的方法能够在一系列实验中生成具有更高质量的国际象棋评论。

臧鸿宇做海报展示

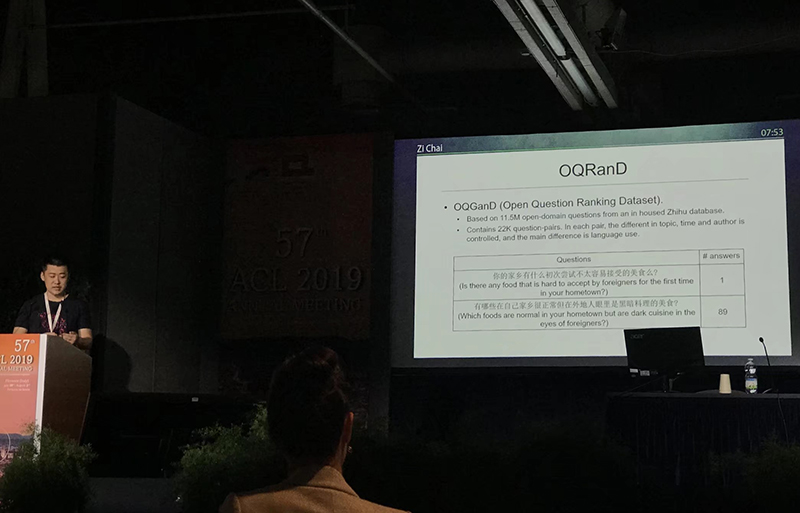

[2] Zi Chai, Xinyu Xing, Xiaojun Wan and Bo Huang. Asking the Crowd: Question Analysis, Evaluation and Generation for Open Discussion on Online Forums.

本文对如何生成具有讨论性的开放式问题进行了探索。基于在线问答社区知乎的大量开放式问题,一方面探讨了提问方式如何影响着问题的可讨论性,并基于所得到的一系列结论设计了问题评估模型,旨在从语言使用角度预测问题值得讨论的程度。另一方面,提出了一种问题生成模型,该模型基于条件对抗式生成网络,并能够从新闻稿件中提出开放式问题以引发一定范围的讨论。一系列实验表明该模型在生成的问题质量和可讨论性上优于已有的文本生成模型。

柴梓做口头报告

[3] Yitao Cai, Huiyu Cai and Xiaojun Wan. Multi-Modal Sarcasm Detection in Twitter with Hierarchical Fusion Model.

本文对多模态讽刺检测问题进行了研究。一方面,基于社交媒体平台 Twitter 创建了一个多模态 (包括图片,文本等不同模态信息) 讽刺检测数据集,另一方面,提出了一种多模态分层融合模型。该模型能够提取文本特征,图像特征和图像属性,并对这三个模态的特征进行重建和融合,以得到最终的特征向量从而进行结果预测。基于数据集的一系列实验表明该模型的有效性以及三种模态的实用性。

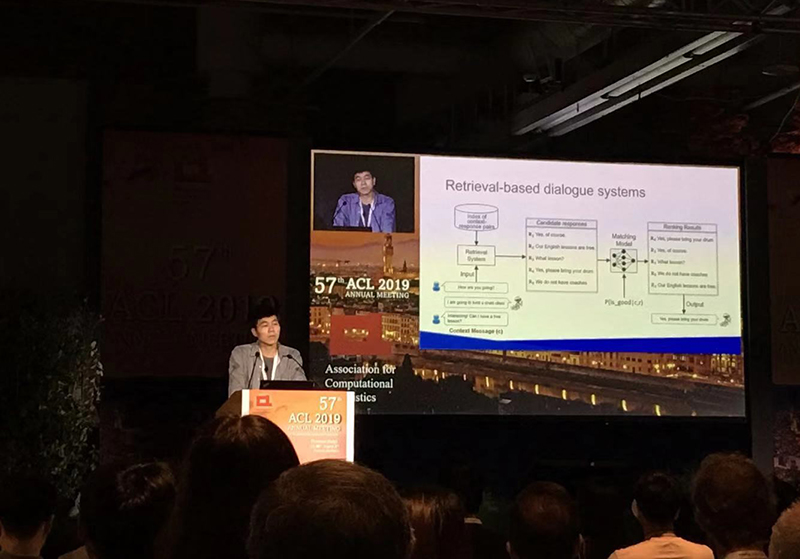

[4] Chongyang Tao, Wei Wu, Can Xu, Wenpeng Hu, Dongyan Zhao and Rui Yan: One Time of Interaction May Not Be Enough: Go Deep with an Interaction-over-Interaction Network for Response Selection in Dialogues

针对检索式对话系统中上下文-回复语义匹配问题,本文提出了从浅层单次交互转向深层次交互,以充分地捕获上下文和响应候选之间的语义关系,该模型在多个标准检索式对话数据集上取得优异的效果。

陶重阳做口头报告

[5] Jiazhan Feng, Chongyang Tao, Wei Wu, Yansong Feng, Dongyan Zhao and Rui Yan:Learning a Matching Model with Co-teaching for Multi-turn Response Selection in Retrieval-based Dialogue Systems.

针对检索式对话系统中上下文-回复语义匹配问题,本文提出了一种“共同教学”的学习框架。在该框架下,又特异性地提出了三种教学策略,用于缓解对话数据集中固有的噪声对现有对话模型训练的影响。该框架能够使现有对话模型的性能得到进一步的提升。

[6] Lisong Qiu, Juntao Li, Wei Bi, Dongyan Zhao and Rui Yan. Are Training Samples Correlated? Learning to Generate Dialogue Responses with Multiple References.

针对生成式对话系统中的通用回复问题,本文通过考虑多个参考回复之间的相关性,提出了一种两步式的生成模型来建模对话中提问与回复之间一对多的映射关系。实验结果显示,该方法相对于基准模型在自动与人工评测指标上均有着更好的表现。

[7] Kun Xu, Liwei Wang, Mo Yu, Yansong Feng, Yan Song, Zhiguo Wang and Dong Yu, Cross-lingual Knowledge Graph Alignment via Graph Matching Neural Network

在解决跨语言知识库间的实体对齐问题时,以往工作主要基于单一语言知识库来学习实体的基本表示,因而很难解决在不同知识库中具有不同事实描述的实体匹配。本文针对这一问题提出了实体主题图的概念,将实体对齐任务转换成了实体所在子图的匹配问题,并设计了一个新的图神经网络匹配算法来解决该问题。实验结果证明,该方法可以在候选实体的事实描述分布不均衡的情况下更充分的利用其邻域上下文信息来判断是否对齐。

上一篇 下一篇